|

Oculistica

|

|

|

|

Ophthalmology

|

|

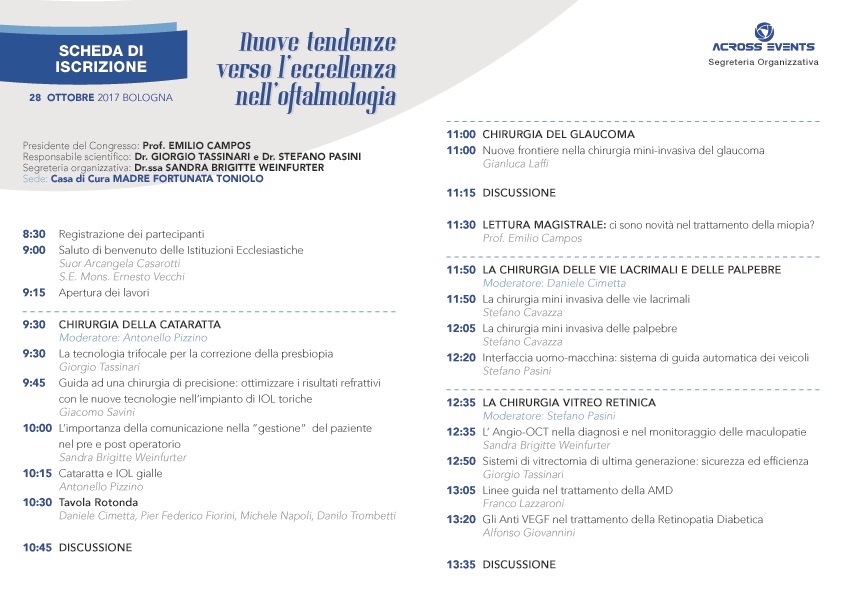

28 Ottobre 2017, Villa Toniolo, Bologna |

Il mio intervento: |

|

Abstract:

Dal momento che i veicoli guida automatica andranno inseriti in un sistema

circolatorio di traffico modellato ab originis secondo le possibilità e le

caratteristiche della visione umana naturale, la guida automatica di

questi veicoli dovrà partire dalla ricostruzione più possibile fedele e

efficace delle caratteristiche funzionali della visione umana stessa. Da

qui derivano gli studi sempre più approfonditi che il settore

dell’elettronica automotive sta

portando avanti in questi ultimi anni, con notevoli ricadute positive

anche per quanto riguarda le ricerche sulla neurovisione.

I.

PERCHE’ LA GUIDA

AUTOMATICA

“People

are still the leading cause of traffic accidents. Around 90 percent can be

attributed to human error: risks are not detected or situations are

misjudged, and the driver reacts too slowly or incorrectly. A higher

degree of automation is the key to considerably decreasing the frequency

of accidents – and, consequently, to reducing the number of fatalities and

the amount of property damage.”

(1)

L’attuale incremento ed

estensione delle ricerche relative alla futura guida automatica degli

autoveicoli pubblici e privati e motivata, come si è visto, da vari motivi

ma fra questi uno dei predominanti è quello della sicurezza. La velocità

di reazione di un sistema automatizzato e bene a punto, dunque

rapidissimo, ottimizzato in ogni suo parte e soprattutto non soggetto a

distrazioni, permetterà nel futuro di ridurre e forse eliminare le

debolezze dell’anello più instabile dell’attuale catena guida, cioè il

guidatore stesso. Per questa ragione, però, proprio il guidatore e in

particolare il suo sistema di visione rappresenta attualmente il terreno

di studio più importante e su cui appare più difficile progredire

rapidamente verso le necessarie finalità.

“In

order for autonomous automobiles to deliver all the promised benefits

safely, there is one crucial milestone to reach; they will all need to

see the world around

them instantaneously and accurately.” (2)

Per la guida automatica

non esistono infatti limitazioni per quanto riguarda la parte motoria

della guida; servomeccanismi e servocomandi, con attuatori idraulici,

elettroidraulici e/o elettromeccanici, svolgono già attualmente un’enorme

quantità di lavoro all’interno di qualsiasi autoveicolo moderno, e questo

potrà essere senza alcun dubbio perfezionato senza necessità di

rivoluzioni profonde. La parte invece più profondamente umana della

conduzione del veicolo rappresenta una sfida enorme perché la riproduzione

di questo processo presuppone una conoscenza delle strutture cerebrali e

della visione che attualmente ancora non abbiamo; e che, soprattutto, non

siamo ancora in grado di replicare in una macchina.

II.

BASE

INDISPENSABILE: LA VISIONE ARTIFICIALE

La ricerca per la

realizzazione di sistemi di visione artificiale effettivamente in grado di

sostituire la vista umana e il cervello in queste procedure è grandemente

avanzata negli anni ma è sicuramente ancora molto lontana dai suoi

obiettivi. D’altra parte, questa visione artificiale rappresenta la pietra

d’angolo fondamentale per realizzare i sistemi di guida automatica.

Il perché è evidente: dal momento che il sistema di circolazione

dei veicoli è stato nel corso degli scorsi secoli plasmata e gradualmente

sviluppata sempre sulla base di ciò che il singolo guidatore può vedere e

a cui può reagire cercando di massimizzare le prestazioni e minimizzarne i

rischi, l’intero sistema complessivo di trasporti, dalle strade ai

veicoli, passando per segnaletica e accessori, è tutta pensata per il

sistema visivo umano. La visione artificiale, per inserirsi in questo

ambiente già organicamente strutturato secondo queste caratteristiche,

dovrà obbligatoriamente seguire gli stessi parametri: dunque vedere le

stesse cose, trasmettere gli stessi segnali e reagire in una maniera

quindi esattamente conforme a quella del sistema visivo umano, pur

nell’aspettativa attuale di ridurne tempi di reazioni e precisione

operativa.

Tale realizzazione è

tutt’altro che semplice, come ben sanno, per primi, i neuroscienziati e

gli studiosi della visione umana. Tutti coloro che si confrontano con

l’attività e le funzioni del cervello delle sue strutture visive e

conoscono bene l’enorme complessità e varietà di funzioni, per le quali è

difficile, ed è finora risultato praticamente impossibile, creare

un’effettiva struttura sostitutiva artificiale. Il fallimento almeno

parziale di avventure solide, bene impostate e generosamente finanziate

come il progetto ‘Blue Brain’

dimostra questa difficoltà.

È doveroso ricordare a

questo punto che l’occhio non è un organo a sé, che invia segnali tramite

un cavo di collegamento al cervello; è a tutti gli effetti

un’estroflessione sensoriale del cervello stesso, il suo neuroepitelio ne

fa parte ed è quindi egualmente complesso e di estrema difficoltà quando

lo si vuole replicare, soprattutto quando lo si vuole ricollegare alle

strutture visive centrali.

La ricostruzione delle

attività sensoriali visive mediante i computer che dovranno supportare

questo processo diventa sempre più complessa e con necessità di hardware

sempre più veloce e preciso; per introdurre questo concetto nell’ambito

della vita attuale, si può menzionare che l’ultimo microprocessore di

Nvidia destinato a avanzare il sistema di visione artificiale per

autoveicoli fino al livello ‘5’ della scala SAE (guida completamente

automatica) è in grado di effettuare 320 milioni di milioni di operazioni

al minuto secondo.

“Nvidia Drive PX is the AI car

computer that enables automakers, truck makers, tier 1 suppliers, and

startups to accelerate production of automated and autonomous

vehicles…… to a multi-chip configuration with four high performance AI

processors — delivering 320 trillion deep learning operations per second

(TOPS) — that enable Level 5 autonomous driving.”

(3)

Una velocità di calcolo

impressionante, eppure non sarà nemmeno lontanamente sufficiente per

arrivare a livello di una specie di ‘IA’.

“IBM

says it has now accomplished this milestone with its new “TrueNorth”

system running on the world’s second-fastest operating supercomputer, the

Lawrence Livermore National Lab (LBNL) Blue Gene/Q Sequoia, using 96 racks

(1,572,864 processor cores, 1.5 PB memory, 98,304 MPI processes, and

6,291,456 threads).

IBM and LBNL achieved an

unprecedented scale of 2.084 billion neurosynaptic cores* containing

53×1010 (530 billion) neurons

and 1.37×1014 (100 trillion) synapses running only 1542 times slower

than real time.

“We have not built a biologically

realistic simulation of the complete human brain,” explains an abstract of

the Supercomputing 2012 (SC12) paper.”

(4)

Nel 2014,

“….Researchers used the K computer

in Japan, currently the fourth

most powerful in the world, to simulate human brain

activity. The computer has 705,024 processor cores and 1.4 million GB of

RAM, but still took 40 minutes to crunch the data for just one second of

(just 1% of) brain activity….Exascale computers are those which can carry

out a quintillion (1018) floating point operations per second,

which is an important milestone in computing as it is thought to be the

same power as a human brain and therefore opens the door to potential

real-time simulation of the organ’s activity.” (5)

L’ingombro di questi

computer è ovviamente tale da precluderne l’utilizzo reale su veicoli che

non siano almeno delle portaerei nucleari…. La complessità del cervello

umano è dunque stupefacente e siamo molto indietro nella possibilità di

replicarne anche solo remotamente le possibilità, un fatto sottolineato

che l’enorme computer ‘Blue Gene/Q Sequoia’ ha potuto imitarne il

funzionamento con una velocità ‘solo

1542 volte più lenta del tempo reale’. (sic) Ma l’ingombro non è il

solo problema di questi immensi supercomputer.

“….To simulate the human brain at

that resolution, we would need supercomputers on the yotta scale, with a

million times more computing power than the exascale machines now on the

horizon. A mouse brain would need a zettascale computer, and a lobster

brain would need exascale. Today’s petascale computers are just enough for

a coarse-grained simulation of a worm, like Rotifera.

An important factor to keep in

mind is that the computers we would need to run high-resolution

simulations of the human brain would probably consume the output of a

dedicated nuclear power plant. When one considers that the brain only

needs a banana to run even higher resolution operations, we can see that

it will take a while for our technology to catch up with the brain.”

(6)

È evidente che le

considerazioni espresse nei testi precedenti portano a loro volta a altre

considerazioni che complicano ulteriormente la realizzazione di sistemi di

guida automatica realmente evoluti, cioè ingombro (quindi anche peso),

consumo di energia e costo complessivo. Anche senza voler arrivare ai

supercomputer che sono stati utilizzati per la simulazione dell’intero

cervello, con risultati come si è visto per ora piuttosto scadenti, va

tenuto presente che il solo processore Nvidia di cui si è parlato prima ha

comunque un prezzo proiettato a un fornitore ‘Tier 1’ di almeno $ 2300,

realmente esorbitante per gli standard dell’industria. Tutte queste

considerazioni rallentano inevitabilmente l’applicazione di questi sistemi

è veicoli attuali, mentre non c’è dubbio che nel futuro la

miniaturizzazione, la diffusione di questi sistemi e la conseguente

riduzione degli ingombri dei costi porterà a rendere queste strutture più

accessibili.

Alla fine del testo, è

utile inserire la classificazione decisa dalla SAE (‘Society

of Automobile Engineers’) a proposito del livello di automazione della

guida e vari veicoli, da ‘0’ (zero) a ‘5’ (cinque). Come si vede, ‘0’

(zero) è il livello della stragrande maggioranza dei veicoli attualmente

in circolazione sulle nostre strade, in cui tutte le operazioni della

vettura sono completamente affidate alla visione, al giudizio e alla

capacità di reazione del guidatore. Gradualmente siamo passati ad una fase

in cui l’automobile può effettuare alcune operazioni, tipo la frenata

automatica in caso di avvicinamento di un ostacolo, e qui siamo a livello

‘1’, con la cauta speranza di arrivare presto al livello ‘2’. I livelli

‘3’ e ‘4’ rappresentano progressivi incrementi dell’assistenza da parte

dei sistemi di bordo alla guida di un essere umano che deve comunque

essere presente e comunque effettuare alcune operazioni non ancora

affidabile alle macchine.

Il Santo Graal della

guida automatica è evidentemente il livello ‘5’: tutto è completamente

automatico, il guidatore diventa sostanzialmente un passeggero perché dopo

aver inserito i dati di navigazione sulla destinazione non deve né può

fare più nient’altro, non c’è più volante, non ci sono pedali,

teoricamente potrebbero non esserci neppure parabrezza o vetri laterali,

l’automobile, ma qui si parla anche di autobus, taxi o autotreni, viene

operata esclusivamente dai sistemi di bordo senza intervento umano. Solo

al livello ‘5’, dove l’intervento umano è del tutto eliminato, potrà

avvenire la definitiva destrutturazione dell’abitacolo come lo conosciamo

oggi, inevitabilmente legato, dal punto di vista architettonico, alla

presenza di volante e pedaliere posti in modo tale da porre il guidatore

nella necessaria posizione fronte marcia.

La strada per arrivare a

questo livello 5, che alcuni vorrebbero molto vicino, è però in realtà

ancora straordinariamente lunga e complessa. Il fatto è che la

replicazione delle funzioni cerebrali, pur volendocisi limitare alle

funzioni necessarie alla guida di un veicolo (e trascurando, per esempio,

quelle relative a cultura, apprendimento, educazione e così via), è un

task immenso la cui semplice comprensione rappresenta, in un certo senso,

un ossimeoro.

"if the brain were so simple we

could understand it, we would be so simple we couldn't."

(7)

Questo ci porta alla

indiscutibile difficoltà di comprendere il cervello:

“That’s

not altogether surprising. We’re talking about an organ that is, by

general agreement, the most complex object in the cosmos.” (8)

Gli ostacoli sono molti,

e non tutti tecnici; uno dei più importanti rimane quello legale, la ‘legal

liability’. Cioè chi, in sostanza, dovrà essere ritenuto responsabile

dell’eventuale incidente di un’automobile una volta che, per le ragioni

più varie e impensabili, l’accidente comunque dovesse avvenire. Ciò

nonostante la tecnica procede e realizza veicoli sempre più ricchi di

sistemi che puntano all’eliminazione della maggior parte dei possibili/

necessari interventi del guidatore.

“The Mercedes S-Class for 2014 is

the first vehicle on the market to offer camera-assisted “magic body

control,” a system that can identify bumps in the road ahead and adjust

the suspension to quell them in real time. A 6D-Vision system, combining

stereo multipurpose cameras and multistage radar sensors, provides spatial

perception up to 50 m ahead of the vehicle to maintain speed behind a car

at speeds of up to 200 km/h. Short-, medium- and long-range radar sensors

at 30, 60 and 200 m provide distance-monitoring information about other

vehicles, oncoming traffic, pedestrians, traffic signs and road markings.

An active lane-maintaining system

uses a side camera and radar sensors to perceive when the vehicle crosses

dashed or solid lane markings. A thermal infrared imaging camera provides

night vision to alert the driver to potential danger from pedestrians,

cyclists or animals in dark conditions.

The Mercedes S-Class for 2014

incorporates numerous vision systems to assist the driver, from a 360°

hazard-alert system to the industry’s first camera-based proactive

suspension system that scans the road to prepare for bumps and dips.

The sensors in the Mercedes

S-Class, one of which can detect whether the driver’s hands are on the

steering wheel, all feed into a single control unit that intelligently

synthesizes the data. Other systems include self-parallel-parking ability,

and 360° monitoring of everything from blind-spot hazards to vehicles

approaching from behind. With all these advanced vision systems already

available commercially, the age of the lazy driver is imminent, especially

in light of ongoing research on the next generation of highly automated

cars.” (9)

Dunque: camera-assisted “magic

body control,” a 6D-Vision system, combining stereo multipurpose cameras

and multistage radar sensors, short-, medium- and long-range radar sensors

at 30, 60 and 200 m An active lane-maintaining system uses a side camera

and radar sensors A thermal infrared imaging camera for night vision, a

360° hazard-alert system, the industry’s first camera-based proactive

suspension system a sensor to detect whether the driver’s hands are on the

steering wheel, fed into a single control unit, self-parallel-parking

ability, 360° monitoring of everything from blind-spot hazards to vehicles

approaching from behind.

Tutto, come dice la

Casa, per ‘favorire il guidatore pigro.’

III.

I PROBLEMI DELLA

VISIONE ARTIFICIALE

In attesa che venga

risolto a livello politico questo attuale impasse, rimane comunque un

enorme enigma tecnico il come realizzare la completa automazione delle

vetture partendo proprio dalla visione. Attualmente, i sistemi di visione

artificiale installabile sull’automobile si avvalgono vari componenti

hardware, fondamentale fra i quali è il LiDAR (‘Light

detection and ranging’). La descrizione che la Velodyne fa di uno dei

suoi LiDAR è esemplificativa.

“The

Velodyne HDL-32E LiDAR sensor is small, lightweight, ruggedly built and

features up to 32 lasers across a 40° vertical field of view. The HDL-32E

measures only 5.7" high x 3.4" in diameter, weighs less than two kilograms

and was designed to exceed the demands of the most challenging real-world

autonomous navigation, 3D mobile mapping and other LiDAR applications.”

(10)

Gli avanzamenti

tecnologici hanno ridotto costi e dimensioni del LiDAR pur con un continuo

incremento di prestazioni e affidabilità. Oltre al LiDAR, i sistemi di

visione artificiale utilizzano laser, radar, sensori periferici che

debbono esaminare l’ambiente a 360° e tutti questi per scegliere il

messaggio che deve essere inviato al cervello principale il quale lo

elaborerà sui dati forniti dal sistema di mapping continuo della zona

(SLAM).

“In

robotic mapping and navigation, simultaneous localization and mapping

(SLAM) is the computational problem of constructing or updating a map of

an unknown environment while simultaneously keeping track of an agent's

location within it.” (11)

Questi dati vengono

incrociati con quelli forniti dal sistema GPS, dai sensori di movimento e

di velocità dall’IMM (‘Inertial

Measurement Movement’) e di moltissimi altri fattori ancora; è

destinato ad avere una sempre maggiore importanza, in questo senso, il

dialogo diretto fra veicoli, ‘V2V’, sempre che le inevitabili guerre

commerciali permettano alla fine di arrivare a un protocollo condiviso di

comunicazione leggero ed efficiente fra veicoli. Tutto questo porterà

infine ad elaborare il comportamento giusto per quel veicolo in quel

preciso istante.

Il cervello elettronico

centrale dell’automobile diventerà quindi l’equivalente del talamo, la

struttura centrale per l’elaborazione dei molti segnali e nella produzione

di sensazioni e stimoli del cervello umano; ricostruire una struttura di

tale complessità e di tanto vasta operatività rappresenta ovviamente una

sfida epocale che si è ancora ben lontani dal vincere. Il già citato

esperimento con il Blue Gene/Q Sequoia rende l’idea della complessità del

trasferimento di questo genere di attività su un sistema artificiale.

È naturale a questo

punto considerare che la guida automatica dovrà avvalersi di sistemi di

vivere propria intelligenza artificiale, ma anche su questo non c’è

accordo su cosa si intenda con questi termini.

“…if

a machine can answer any question

put to it, using the same words that an ordinary person would, then we may

call that machine intelligent.” (12)

La classica definizione

di Turing è stata poi successivamente contestata, in quanto eccessivamente

antropomorfa e pertanto non adattabile a ciò che si intende ottenere dalla

vera e propria intelligenza artificiale, che è un miglioramento delle

prestazioni dei sistemi a cui questa viene applicata.

Russell e

Norvig, autori di ‘Artificial

Intelligence: A Modern Approach’ affermano ad esempio che“…aeronautical

engineering texts do not define the goal of their field as 'making

machines that fly so exactly like pigeons that they can fool other

pigeons’.” (13)

Il concetto espresso dai

due scienziati è particolarmente adattabile all’automobile con guida

automatica, in quanto quello che si vuole cercare non è semplicemente la

replicazione del comportamento del guidatore umano in ogni condizione, ma

un superamento delle sue limitazioni per ottenere un concreto

miglioramento del sistema complessivo di circolazione in termini di

efficienza e di sicurezza.

“It

is one thing for artificial systems to be able to see moving targets, but

tracing movement so it can move out of the way of those things is a really

important aspect to self-steering vehicles.” (14)

IV.

LO SFRUTTAMENTO

OTTIMALE DELLE STRADE

Se la sicurezza di

circolazione e la riduzione degli incidenti nel sistema traffico è

ufficialmente tale e assoluto di tutte queste ricerche, nella realtà vi

sono molte altre considerazioni che portano a finanziare ricerche per la

guida automatica su vasta scala. La progressiva applicazione generalizzata

di veicoli a guida automatica porterà infatti a cambiare completamente le

prospettive del traffico, dove ora è necessario mantenere distanze di

sicurezza misurate ai tempi di reazione del guidatore umano, alla sua

attenzione/disattenzione, al tempo di reazione occhio-pedale (pesantemente

influenzato, fra l’altro, dalla qualità della visione del guidatore

stesso, dalle condizioni ambientali e così via) con il risultato di dovere

mantenere ampi spazi di sicurezza vuoti fra una vettura e l’altra; le

vetture a guida completamente automatica, che avranno non solo tempi di

reazione istantanei per adattarsi alle differenze di velocità del traffico

ma anche la possibilità di parlarsi fra di loro, quindi di vedere oltre i

veicoli immediatamente precedenti e successivi, ridurranno invece queste

distanze a pochissimi metri, creando veri e propri ‘convogli stradali’ con

un conseguente molto migliore sfruttamento della rete stradale.

“Currently,

maximum controlled-access highway throughput or capacity according to the

U.S. Highway Capacity Manual is about 2,200 passenger vehicles per hour

per lane, with about 5% of the available road space is taken up by cars.

One study estimated that

autonomous cars could increase capacity by 273% (~8,200 cars per hour per

lane).

The study also estimated that with

100% connected vehicles using vehicle-to-vehicle communication, capacity

could reach 12,000 passenger vehicles per hour (up 445% from 2,200 pc/h

per lane) traveling safely at 120 km/h (75 mph) with a following gap of

about 6 m (20 ft) of each other.

Currently, at highway speeds

drivers keep between 40 to 50 m (130 to 160 ft) away from the car in front.”

(15)

La realizzazione di

questo concetto, per ora teorico, è legato all’automazione completa di

tutte le funzioni di conduzione del veicolo, e del rapporto con gli altri

utenti della strada, in particolare con gli altri componenti del flusso

veicolare. Questo eleverebbe enormemente il punto di saturazione delle

strade, alleggerendo parimenti i problemi di traffico, code e blocchi del

traffico.

“In

traffic engineering, the degree of saturation of an intersection

(typically under traffic signal control) or road is a measure of how much

demand it is experiencing compared to its total capacity.” (16)

Rimane parzialmente

irrisolto il problema dell’inserimento del singolo veicolo nel flusso del

traffico, una volta che gli altri veicoli siano agganciati in una forma

ideale di convoglio stradale a distanza estremamente ravvicinata, ma anche

questo potrà essere risolto con opportuni protocolli e soprattutto con il

colloquio continuo ‘V2V’ fra i vari veicoli circolanti su quella

carreggiata.

V.

UN VEICOLO PER

TUTTI

Va da sé che il concetto

di guida altamente automatizzata permetterà di estendere l’utilizzo di

qualsiasi veicolo, e in particolare dell’automobile privata, in maniera

sostanzialmente maggiore di quanto non avvenga ora; esso permetterà

infatti in un certo senso di superare il concetto di patente di guida,

sostituito dal semplice certificato di proprietà di un veicolo di

categoria cinque quindi completamente automatizzato e come tale utilizzato

anche da persone non vedenti perché comanda abile con il semplice comando

vocale, mentre in una prospettiva più estrema si potrebbe anche

considerare di permettere l’utilizzo di questi veicoli a persone con

caratteristiche psichiche attualmente non idonea alla guida, o sotto

l’effetto di alcolici o stupefacenti perché il cervello elettronico di

bordo dell’automobile di livello ‘5’ è programmato in maniera da non

effettuare alcuna manovra che non sia strettamente aderente al codice

della strada, mentre d’altra parte ovviamente i suoi sensori

continuerebbero a operare in maniera completamente automatica ed efficace.

VI.

ETICA E LEGGI

DELLA ROBOTICA

In ogni momento in cui

un guidatore conduce il suo veicolo, si confronta con una miriade di

situazioni, le più differenti fra loro e spesso in conflitto. Parlando

dello stato attuale dell’arte della guida automatica, bisogna sempre

tenere presente che siamo a dei livelli piuttosto bassi rispetto alla

scala proposta dalla SAE, cioè livello due, molto raramente tre. Per

arrivare al ‘4’ e soprattutto al ‘5’ c’è ancora moltissima strada da

percorrere, e quando si arriverà a questi livelli, quando cioè

l’intervento umano in una situazione di emergenza non solo non sarà più

necessario, ma non sarà più neppure consentito, entrerà inevitabilmente in

gioco una serie di questioni etiche e morali di non piccolo rilievo. In

sostanza questo può essere rappresentato dal dilemma che il sistema di

intelligenza artificiale dovrà risolvere fra il travolgere il bambino che

sta attraversando la strada (fuori dalle strisce e inopinatamente, cioè al

di fuori di qualsiasi protocollo ‘normale’) per rincorrere il pallone e

sterzare invece bruscamente per evitarlo, finendo contro un palo della

luce e probabilmente quindi uccidendo il guidatore dell’automobile. È un

esempio estremo ma paradigmatico del dilemma a cui l’essere umano risponde

non solo con un l’insieme delle sue reazioni neuronali, neurosensoriali e

meccaniche ma anche con il profondo substrato etico che deriva da

educazione, convenzione, convenienza. Come farà un’intelligenza

artificiale di livello elevato ma non ancora completo, come quello che nel

ranch a dei prossimi 10, 15 anni può essere applicata a un’automobile, a

arrivare a produrre dei ragionamenti etici di questa importanza?

A questo punto vengono

inevitabilmente in mente le tre famose “leggi

della robotica” profeticamente enunciate a suo tempo da Isaac Asimov e

ora straordinariamente attuali.

Prima Legge: “Un

robot non può recar danno a un essere umano né può permettere che a causa

del proprio mancato intervento un essere umano riceva danno”.

Seconda legge: “Un

robot deve obbedire agli ordini impartiti dagli esseri umani purché tali

ordini non contravvengano alla prima legge”.

Terza legge: “Un

robot deve proteggere la propria esistenza purché questo non contrasti con

la prima e la seconda legge”.

Una successiva aggiunta è la

cosiddetta ‘Quarta Legge’ valida solo per gli automi più sofisticati,

definita ‘Legge Zero’ (‘Zeroth Law’):

“Un robot non può recar danno

all’umanità e non può permettere che, a causa di un suo mancato

intervento, l’umanità riceva danno”. (17)

VII.

INTELLIGENZA

ARTIFICIALE, I.A. ‘DELLA MACCHINA’

Il tutto si innesta su

sistemi in cui, per ragioni sia economiche che di livello tecnologico

reale, siamo ancora a livello di ‘Weak

AI’, cioè di intelligenza artificiale debole, di basso livello.

Proprio questo basso livello di intelligenza rappresenta per alcuni un

pericolo maggiore di quello del completo controllo umano.

"Narrow AI could knock out our

electric grid, damage nuclear power plants, cause a global-scale economic

collapse, misdirect autonomous vehicles and robots...”

(18)

Lo ‘Stanford

Center for Internet and Society’ ritiene che la crescita dei sistemi

di ‘weak’ o ‘narrow’

presenti reali problemi:

“…Weak or "narrow" AI, in

contrast, is a present-day reality. Software controls many facets of daily

life and, in some cases, this control presents real issues. One example is

the May 2010 "flash crash" that caused a temporary but enormous dip in the

market” (19)

Si vede dunque che

numerosi studiosi del settore ritengono che la cosiddetta intelligenza

artificiale debole sia più dannosa della assenza completa di questi tipi

di assistenza. In sostanza, per questi specialisti, o si passa il più

presto possibile all’intelligenza artificiale ‘vera’, il che, tradotto nel

sistema veicolare vuol dire veicoli di livello 5, oppure la via di mezzo

può paradossalmente essere addirittura dannosa. Un classico esempio è

l’incidente accaduto circa un anno fa al guidatore di una delle automobili

attualmente in circolazione con l’assistenza di livello 2, quindi a tutti

gli effetti pilotata da una intelligenza ‘debole’. Durante una manovra di

un autoarticolato che svoltava verso sinistra, i sistemi di visione e i

cervelli elettronici interni, composti da un numero relativamente esiguo

di sensori e con una capacità di elaborazione ridotta, hanno interpretato

la fiancata bianca del camion stagliata contro il cielo nebbioso come un

tutt’uno, quindi hanno ritenuto che la strada fosse libera e hanno

proseguito nella marcia a velocità di crociera con il risultato che

l’automobile si è schiantata contro la autoarticolato e il conducente è

morto.

A sottolineare la

relativa pericolosità di questi ‘sistemi deboli’ è che le successive

perizie tecniche effettuate per ovvi scopi medico-legali hanno accertato

che il conducente ha avuto più di sette secondi di tempo per realizzare

che l’automobile stava proseguendo la sua marcia ma, completamente

assorbito in altre cose e poi probabilmente incredulo di fronte

all’assenza di qualsiasi rallentamento della vettura, non è intervenuto.

Se egli fosse stato alla guida di un veicolo classe 0 o 1 avrebbe

controllato la strada e avrebbe frenato in tempo; un veicolo automatico di

classe 4 o 5 avrebbe avuto a disposizione molti più dati per elaborare il

concetto dell’autoarticolato che stava sterzando davanti a sé e avrebbe

autonomamente frenato la vettura. Sotto inchiesta è comunque finita la

decisione del fondatore della Casa produttrice di non installare LiDAR

sulle sue Tesla.

“For

full autonomy you’d really want to have a more comprehensive sensor suite

and computer systems that are fail-proof. That said, I don’t think you

need LiDAR. I think you can do this all with passive optical and then

maybe one forward radar” (20)

Un altro esempio nel

quale l’intelligenza artificiale debole, e quindi una guida automatica di

medio livello di assistenza potrebbe diventare pericoloso è quello del

pedone che inizia ad attraversare la strada al di fuori delle strisce

pedonali. Se il guidatore abituale è allenato a riconoscere il pedone che

inizia la manovra di attraversamento, identifica il movimento e può quindi

decidere cosa fare, il sistema di guida automatico medio, non vedendo

alcuna striscia pedonale della segnaletica orizzontale di quel tratto di

strada, sarà portato a non fermare il veicolo, perché il pedone non deve

attraversare. Se il pedone attraversa lo stesso, l’automobile dovrà

mappare la posizione del pedone, registrarne il movimento e effettuare la

frenata o un movimento di scarto in un tempo molto più ristretto di quello

che potrebbe fare guidatore stesso o l’intelligenza artificiale vera di

livello 5, la quale, completamente automatica, inizia a frenare prima di

arrivare a ridosso del pedone perché è stata educata a sapere che il

pedone potrebbe attraversare anche fuori delle strisce pedonali. Per

questa ragione molti ritengono che i livelli 2 o 3 di guida automatica

siano da affrontare con molta cautela.

VIII.

I PROBLEMI

ESISTONO-1: LE INFRASTRUTTURE

Al di là dei problemi

legali, cioè della responsabilità civile e penale del proprietario del

veicolo o di quello che ne è ufficialmente il conduttore in condizione di

guida automatica, rimane un grande punto interrogativo sulla possibilità

effettiva dei sistemi di bordo di questi veicoli di trarre tutte le

informazioni necessarie e indispensabili ad una loro marcia rapida,

efficiente e soprattutto sicura da infrastrutture che non sono sempre

all’altezza di questa funzione. Dovendo utilizzare le strade attuali, non

potendo quindi contare sul supporto eventuale di sensori attivi e passivi

annegati nel fondo stradale o di altri metodi di informazione avanzati

sicuramente affidabili, i veicoli a guida automatica devono raccogliere

informazioni necessarie alla marcia dalla segnaletica orizzontale e

verticale. Questa, in un mondo ideale, permetterebbe di raccogliere tutte

le informazioni necessarie semplicemente leggendo le linee bianche o

gialle, continue intermittenti, singolo doppio sulla carreggiata, più le

rispettive indicazioni con frecce, indicazione di corsi di svolta e così

via; mentre la lettura ottica rapida con un semplice sistema OCR della

cartellonistica stradale dovrebbe bastare a fornire informazioni sulla

velocità massima consentita e altre indicazioni del caso.

In realtà, la condizione

di tali infrastrutture è tutt’altro che omogenea e molto spesso assai

carente, basti pensare ai tempi che possono intercorrere tra la

riasfaltatura di un pezzo di strada e la successiva verniciatura delle

linee sulla stessa; sulla sovrapposizione di più cartelli che spesso

vengono disordinatamente sovrapposti uno all’altro cosicché l’indicazione

principale rimane molto spesso nascosta o visibile solo da alcune

angolazioni; l’inserimento in incroci e prossimità stradali di cartelli

pubblicitari assai aggressivi in termini di dimensioni e luminosità

notturna. Se per alcune cose la guida mediante indicazione satellitari può

ovviare a alcuni problemi (ad esempio i limiti di velocità), ben diverso

si presenta il caso in cui esistano condizioni locali di cui il sistema

satellitare non è informato, che può andare dal restringimento di

carreggiata alle deviazioni e altri fattori imprevisti. Questo costituisce

un cono d’ombra importante per i sistemi di guida automatica, proprio

perché essi devono essere utilizzati sul sistema circolatorio già

esistente. Questo costituisce un importante challenge per i sistemi di

bordo, dalla visione artificiale all’intelligenza artificiale complessiva

del sistema.

Per quanto evoluti siano i sistemi di bordo qui viene affidata la gestione complessiva di un veicolo a guida automatica, vi possono essere difetti, guasti e malfunzionamenti degli stessi, sia a livello di hardware che di software. Il rimedio più classico, mutuato dall’aeronautica, è prevedere una adeguata ridondanza dei sistemi; questo può sicuramente supplire all’eventuale fallimento di uno di questi sottosistemi dei relativi componenti. Tale impostazione si scontra però con un problema di costi che già è rilevante per i sistemi primari; l’aggravio di costi che la ridondanza impone a livello aeronautico è ovviamente giustificato dall’elevato valore premium del prodotto aeronautico, proverbialmente il più costoso dei mezzi di trasporto privati, mentre diventerà motivo di resistenza iniziale per gli acquirenti e poi di competizione fra i fabbricanti. Essendo l’hardware ormai solo una commodity i cui prezzi sono comunque destinati a scendere nel corso della loro vita utile, questo potrebbe non essere un problema; potrebbero rimanere impegnativi, almeno sul breve-medio periodo, i problemi degli ingombri e dell’alimentazione di un hardware tanto evoluto e multifunzione. (21)

X.

I PROBLEMI

ESISTONO-3: IL METEO

“…Rain

is an issue for self-driving cars as it can reduce the range and accuracy

of laser-based lidar sensors, obscure the vision of on-board cameras, and

create confusing reflections and glare.” (22)

Meno difficile può

essere considerata la risposta del sistema automatico a altre condizioni

impreviste come la presenza di veicoli di soccorso o di forze dell’ordine

sulla carreggiata; non pone infatti particolari difficoltà la

programmazione del calcolatore centrale per rallentamenti o arresti

completi in caso di luci gialle o blu, opportunamente differenziate come

scala di importanza e come reazione necessaria.

Il collegamento sempre

più completo di tutto il complesso di visione artificiale ai sistemi di

visione ‘low-light’ (sensori infrarossi, radar etc) sicuramente riduce

questo inconveniente a livelli molto accettabili ma il maltempo e le

condizioni meteo difficili creano l’equivalente, per la visione umana, del

‘glare’ di vario livello (‘disconfort glare’, ‘disability glare’) e non

vanno sottovalutati soprattutto per la possibilità che ingenerino nei

cervelli elettronici di bordo una errata interpretazione

dei segnali e quindi una ricostruzione spazio-temporale sbagliata:

una sorta di Sindrome di Charles Bonnet della macchina, con effetti

potenzialmente catastrofici.

“L’allucinazione

è una percezione che avviene quando la corteccia sensoriale è attivata in

assenza di una corrispondente stimolazione dei recettori periferici,

ovvero: una percezione in assenza di stimoli (gli ‘oggetti’).” (23)

XI.

I PROBLEMI

ESISTONO-4: FURTI, HACKING

Un altro aspetto assai

delicato dell’uso quotidiano di veicoli a guida completamente automatica,

al di sopra almeno del livello ‘3’, è la necessità di realizzare e

applicare con assoluta affidabilità sistemi di protezione dall’uso

improprio. Man mano che sono progrediti i sistemi elettronici di ausilio

all’uso dell’automobile sono progrediti anche gli hacker che approfittano

delle vulnerabilità del sistema. Un esempio classico è quello della chiave

elettronica sistema keyless, una tipica applicazione di intelligenza

artificiale debole preposta al solo scopo di permettere di aprire,

chiudere e avviare l’automobile senza un contatto fisico fra la chiave

stessa e il veicolo. Si è visto subito che i ladri, in possesso dei

necessari strumenti di hacking, hanno ben presto realizzato il sistema per

clonare il segnale di questa chiave elettronica, replicarlo e quindi

appropriarsi senza alcuna fatica del veicolo. (24)

Al di là dei furti,

però, potrebbe diventare molto più pericoloso l’ingresso nei sistemi di

guida del veicolo, con la possibilità di appropriarsi del veicolo stesso

dei suoi occupanti cambiando direzione, quindi dirottandolo per i più vari

scopi, dal furto al sequestro di persona, se non per creare incidenti con

vere e proprie finalità terroristiche.

In questo senso

diventerà sempre più importante la protezione del sistema di guida

automatico con procedure e protocolli particolarmente evoluti, anche se

tutto questo dovrà scendere ai necessari compromessi per mantenere una

buona facilità d’uso, consentire l’accesso a bordo a più persone

autorizzate dal proprietario senza che questo implichi la completa

riprogrammazione del sistema, e conservando una necessaria back door per

gli interventi di emergenza nel caso che vi fossero improvvise esclusione

del sistema.

Tutto questo, molto

semplice da esporre sulla carta, porterà però inevitabilmente a una serie

di complicazioni notevoli per la realizzazione di più layer di protezione

del veicolo e dei suoi sistemi di bordo, soprattutto, in questo caso, per

i livelli più evoluti cioè il ‘4’ e il ‘5’, in cui l’intervento umano non

è praticamente più previsto. Non a caso è proprio sulla possibilità della

intercettazione per via telematica e quindi della influenza esterna sulla

guida dei veicoli automatici che si stanno attualmente concentrando studi

molto seri e approfonditi che sanno di dover risolvere un problema

potenzialmente cruciale nell’ambito di un sistema di trasporti

completamente affidato alle macchine.

XII.

UN GRANDE

FRATELLO?

La guida completamente automatizzata del

veicolo porterà con sé alcune caratteristiche funzionali che forse

l’utente medio non ha ancora completamente considerato. Già ai livelli ‘3’

e ‘4’, ma soprattutto e definitivamente con l’elusivo ‘5’, i mezzi di

trasporto automatizzati saranno obbligati dalla programmazione EPROM del

cervello di bordo, ovviamente omologato e controllato in maniera

legalistica, a seguire in maniera assoluta tutti i regolamenti del codice

della strada, i limiti di velocità, le precedenze, i semafori, gli

incroci. A patto che siano informati in tempo reale (ed è giusto ricordare

a questo punto che gran parte della tecnologia applicata alla guida

automatizzata si affida alla continua connessione di rete ad alta

velocità) i veicoli si adegueranno in maniera tempestiva e

non

modificabile dal guidatore anche a

limiti temporanei, alle deviazioni di traffico e alle segnalazioni locali

per quanto riguarda divieti di traffico e simili. I veicoli saranno anche sorvegliati totalmente e continuamente dai sistemi elettronici di controllo del traffico; nati ovviamente per aiutare l’automobile a compiere al meglio il suo servizio di portare gli occupanti (non si potrà a questo punto più parlare di ‘guidatore’) dal punto di partenza alla destinazione, diventeranno altrettanto ovviamente punti di riferimento immediati per le forze dell’ordine, per le agenzie di investigazione, e prevedibilmente anche per chiunque riuscisse abusivamente entrare all’interno dei cervelli elettronici di base. Questo realizza un frammento, certamente non secondario, di quel grande progetto di sorveglianza globale di un popolo teorizzato da George Orwell e che sta ora per materializzarsi, passo dopo passo, nella continua connessione di rete che, applicata ogni individuo, ne permette una traccia abilità totale; applicata ai veicoli stradali, non solo ne potrà registrare i movimenti ma, all’occorrenza, studiarne gli itinerari e se necessario deviarli o fermarli del tutto. Un orizzonte molto più vicino di quanto non si possa pensare, che parte già dall’idea del colloquio fra automobili e con i centri di controllo superiore della casa madre; uno scenario per il quale forse sarebbe necessario che la politica impostasse un serio lavoro di legislazione per tutelare sì le prerogative del marketing, l’utilizzo efficiente delle strade e le necessarie funzioni di sicurezza, ma anche la privacy e la libertà reale di movimento dei cittadini. Is Big Brother watching you? (25)

XIII.

CONCLUSIONI (2017)

Come si è visto, la direzione è ormai univoca, senza possibilità di

ritorno, ed è quella di una conduzione sempre più automatizzata fino

all’esclusione dl guidatore umano del processo di guida: l’unica variabile

reale è l’orizzonte temporale nel quale si può prevedere di collocare il

momento in cui il 50% delle vetture circolanti sulle nostre strade saranno

a guida completamente automatica, cioè il livello ‘5’. Potrebbe essere tra

10 anni, forse fra 15 o 20, ma per varie ragioni questo momento arriverà.

Per ora rimangono comunque da risolvere problemi tecnologici enormi, che

rendono per molte ragioni questi sistemi ancora imperfetti e con aree

d’ombra importanti; e se anche si può considerare che la funzionalità dei

sistemi di visione artificiale e la limitata intelligenza artificiale

necessaria alla guida della macchina possono essere elevati a livelli

sufficienti in un periodo di tempo relativamente breve, rimane per ora

aperto il problema della loro dimensione, senz’altro ancora scoraggiante,

dell’alimentazione, destinata a inserire altri problemi logistici

all’interno di un veicolo, e, ultimo ma forse nel lungo periodo meno

importante, il costo; inizialmente senz’altro elevatissimo, ma poi

destinato inevitabilmente a scendere con una certa rapidità.

Molto più importanti appaiono le difficoltà di inserire nell’attuale

flusso di traffico, dove tutti i veicoli sono SAE Level 0-1, macchine con

un’assistenza molto più avanzata i cui proprietari proprio per questo

presteranno sempre meno attenzione al traffico stesso e agli inevitabili

imprevisti. Un mix che potrebbe inizialmente risultare e che per questo

creerà inizialmente forti scompensi.

Di ancor più difficile insolvibilità immediata, però, rimangono i problemi

relativi all’etica della circolazione stradale e all’adattamento che il

cervello elettronico di bordo dovrà compiere per adattarsi ad un sistema

di traffico regolato da processi in larga parte estranei alla rigida

dogmaticità delle macchine. Per creare una certa flessibilità di pensiero

dei computer destinati al gioco degli scacchi è stato sufficiente

elaborare degli algoritmi che hanno permesso alle macchine di digerire

migliaia di partite e rielaborare da queste un protocollo sicuramente

vincente con qualsiasi campione; molto più difficile appare che le

macchine possano essere educate in un breve periodo ad una linea di

pensiero accettabile per l’etica umana normale nel comportamento nei

confronti di situazioni anomale, soprattutto quando il pericolo coinvolge

non il veicolo coi suoi occupanti ma un attore esterno del traffico.

Ancora una volta, la politica sarebbe chiamata a porsi in prima persona

questi problemi e cercare di risolverli per il bene della comunità

facilitando, con una legislazione rapida e sperabilmente illuminata, la

stabilizzazione di un ambiente in cui gli operatori potrebbero portare

avanti le loro ricerche e le relative realizzazioni con relativa

tranquillità, senza la Spada di Damocle dell’arrivo improvviso di

normative disomogenee e talvolta bizzarre che hanno inevitabilmente

l’effetto di disorientare e rallentare il progresso. Ma sperare in questo

è come aspettare l’arrivo di una seconda Cometa su Betlemme.

XV.

RIFERIMENTI

1)

http://www.bosch-mobility-solutions.com/en/highlights/automated-mobility/automated-driving/

6)

https://spectrum.ieee.org/robotics/artificial-intelligence/

henry-markram-talks-brain-simulation

7)

Lyall Watson, 1973

8)

https://aeon.co/ideas/why-trying-to-simulate-the-human-brain-is-a-waste-of-energy

9)

http://techcenter.mercedes-benz.com/it_IT/magic_body_control/detail.html

10)

http://velodynelidar.com/hdl-32e.html

11)

https://en.wikipedia.org/wiki/Simultaneous_localization_and_mapping

12)

https://en.wikipedia.org/wiki/Turing_test

14)

https://www.theengineer.co.uk/dragonfly-inspires-predictive-vision-for-driverless-cars/

15)

https://en.wikipedia.org/wiki/Highway_Capacity_Manual

16)

https://en.wikipedia.org/wiki/Degree_of_saturation_(traffic)

17)

https://en.wikipedia.org/wiki/Three_Laws_of_Robotics

18)

George Dvorsky, 2013, via io9

19)

Ryan Calo, Center for Internet and

Society, Stanford Law School, 30 August 2011.

20)

Elon Musk, 2016

21)

https://en.wikipedia.org/wiki/Redundancy_(engineering)

22)

The

Guardian, 9 February 2016

23)

Charles Bonnet, 1769

24)

https://www.wired.com/2017/04/just-pair-11-radio-gadgets-can-steal-car/

25)

https://genius.com/George-orwell-nineteen-eighty-four-book-1-chapter-1-annotated

26)

XVI.

SOMMARIO

VISIONE ARTIFICIALE E GUIDA

AUTOMATIZZATA DELL’AUTOMOBILE

I.

PERCHE’ LA GUIDA AUTOMATICA

II.

BASE INDISPENSABILE: LA VISIONE ARTIFICIALE

III.

I PROBLEMI DELLA VISIONE ARTIFICIALE

IV.

LO SFRUTTAMENTO OTTIMALE DELLE STRADE

VI.

ETICA E LEGGI DELLA ROBOTICA

VII.

INTELLIGENZA ARTIFICIALE, I.A. ‘DELLA MACCHINA’

VIII.

I PROBLEMI ESISTONO-1: LE INFRASTRUTTURE

IX.

I PROBLEMI ESISTONO-2: AFFIDABILITA’

X.

I PROBLEMI ESISTONO-3: IL METEO

XI.

I PROBLEMI ESISTONO-4: FURTI, HACKING

XIV.

SAE DRIVING ASSISTANCE CLASSIFICATION

|

|

Stefano Pasini, Bologna, 27-X-2017 |

|

|

The Amsler Grid |

|

Pagine obsolete e varie |